Собрали ещё несколько интересных работ вдогонку прошедшей конференции. Сегодня — об оптимизации больших моделей, новых SGD-подходах и работе на тему conformal prediction.

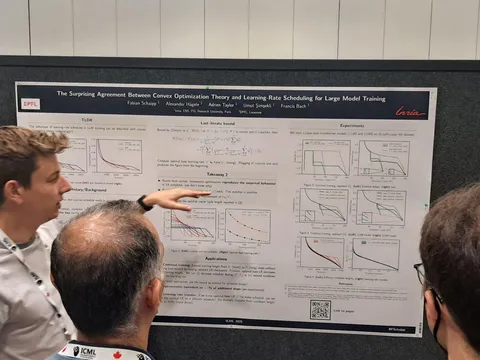

The Surprising Agreement Between Convex Optimization Theory and Learning-Rate Scheduling for Large Model Training

Крайне любопытная теоретическая статья, показывающая (без доказательства — прямо на постере: «we don't know why»), что график лоссов LLM-претрейна с cosine и WSD lr-шедулерами выглядит практически так же, как график теоретических верхних оценок расстояния финальной точки оптимизации от точки оптимума для выпуклых негладких задач при использовании SGD с cosine/WSD-шедулерами. Что ещё любопытнее — теоретические оценки выводятся для SGD, однако графики LLM-претрейна авторы запускали с Adam — использование адаптивных оптимизаторов ведёт к таким же результатам. Авторы также утверждают, что шедулер WSD удобнее для экспериментов со scaling law.

General framework for online-to-nonconvex conversion: Schedule-free SGD is also effective for nonconvex optimization

Статья берёт новый алгоритм оптимизации Schedule-Free из работы The Road Less Scheduled, демонстрировавшей лучшие на момент публикации результаты в бенчмарке методов оптимизации, и разрабатывает инструменты для теоретического анализа в невыпуклых случаях. Идея Schedule-Free в том, что большинство шедулеров на самом деле похожи на усреднение итераций — алгоритм выглядит схожим образом, как хитрое усреднение параметров итераций. Достоинство подхода — алгоритму не нужно наперёд знать число итераций T для задания расписания шедулера. Текущая статья — теоретическая работа, показывающая, как алгоритм ведёт себя в невыпуклых сценариях. Значительное количество статей по методам оптимизации доказываются для задачи онлайн-обучения в терминах regret — в данной статье авторы также решили воспользоваться достоинствами regret-формулировок для анализа.

Decision Theoretic Foundations for Conformal Prediction: Optimal Uncertainty Quantification for Risk-Averse Agents

На конференции было как минимум 10 (а скорее — больше) статей на тему conformal prediction — её сейчас активно исследуют. Conformal prediction — когда модель предсказывает не один label, а множество, и нужно предсказать такое множество, которому с заданной уверенностью принадлежит правильный ответ. Мы пообщались с автором этой работы — он подробнее рассказал о подходе, математических идеях, а также о том, как эти идеи соотносятся с реальными задачами. Выглядит как хорошая точка входа, чтобы разобраться в теме.

Интересное отобрал

ML Underhood

#YaICML25