Как прошла CIKM 2025: взгляд изнутри

Недавно в Сеуле закончилась международная конференция CIKM 2025. Своими впечатлениями о ней поделился Александр Михеев, руководитель группы разработки сервисов моделей.

Продолжаем следить за индустрией и рассказывать о главных мировых ML-конференциях.

ML Underhood

Недавно в Сеуле закончилась международная конференция CIKM 2025. Своими впечатлениями о ней поделился Александр Михеев, руководитель группы разработки сервисов моделей.

Мне впервые довелось съездить на CIKM. Сеул порадовал и золотой тёплой осенью (днём температура поднималась до +19), и хорошо организованной конференцией в центре знаменитого района Гангнам.

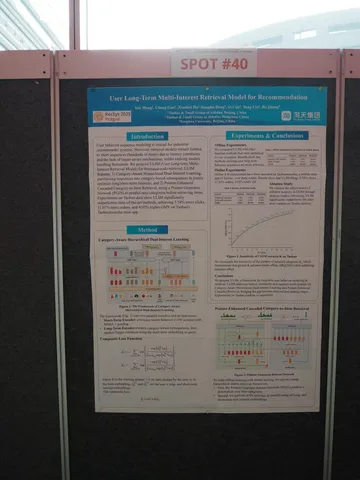

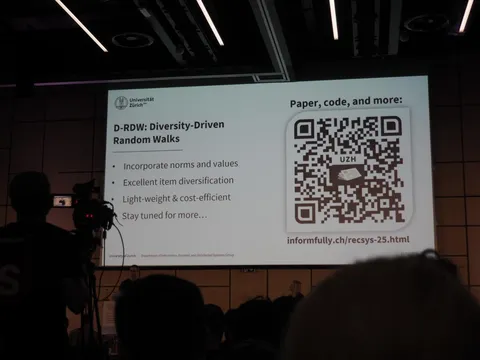

Послушал много интересных докладов. Больше всего впечатлили работы от крупных китайских компаний: TikTok, Kuaishou, Alibaba, Meituan, NetEase. В частности, удалось подробно поговорить с коллегами из Kuaishou. Это вторая по популярности платформа для просмотра и загрузки коротких видео в Китае, которая в этом году наделала шума техническим отчётом об их end-to-end-генеративной системе рекомендаций OneRec. На CIKM они представили серию сильных работ, напрямую релевантных направлению развития рекомендательных систем в Яндексе.

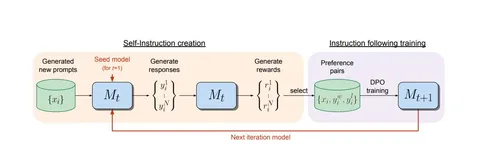

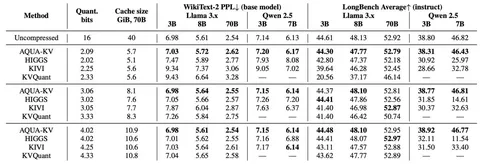

Для меня, как представителя ML-инфраструктуры, самым интересным был доклад по статье MARM: Unlocking the Recommendation Cache Scaling-Law through Memory Augmentation and Scalable Complexity. В ней предлагается для трансформерных рекомендательных моделей перенести часть вычислений KV-матриц в офлайн, складывать их в отдельное хранилище и переиспользовать при инференсе в реалтайме. С инфраструктурной точки зрения схема нетривиальна: из-за большого размера KV-матриц возрастает нагрузка на пропускную способность отдельных компонентов — сети и шины памяти. Но при личном разговоре с докладчиком удалось узнать основные приёмы, которые помогают смягчить эти ограничения. Всё протестируем и вернёмся рассказать о них.

Из любопытных впечатлений. Я ехал на конференцию с ощущением, что буду тихо сидеть в углу и смотреть на тяжеловесов с передового края науки (индустриальной, прикладной, академической), до которых нам ещё далеко. А на деле, по многим направлениям уровень наших исследований и инфраструктуры рекомендательных систем не уступает крупным зарубежным компаниям. Мы можем чаще публиковать доклады о наших внедрениях на академических конференциях.

При этом огромная конкуренция в Китае стремительно продвигает индустрию рекомендательных систем вперёд. Поэтому расслабляться однозначно не стоит.

Продолжаем следить за индустрией и рассказывать о главных мировых ML-конференциях.

ML Underhood

1 471 просмотров · 21 реакций

Открыть в Telegram · Открыть пост на сайте