Конференция в разгаре, а инженеры из Яндекса продолжают отмечать и комментировать любопытные работы. Делимся ими с вами.

AI's Models of the World, and Ours

Invited talk от Джона Кляйнберга — об отличиях в представлениях о мире у моделей и у человека. Мотивация примерно такая: после наступления сингулярности человеческий труд во многих областях станет не нужен, и это как минимум обидно, если не сказать страшно. Хочется, чтобы люди продолжали что-то делать. Чтобы представить эту ситуацию, можно обратиться к задаче, где она уже произошла: к игре в шахматы. Несмотря на то, что компьютеры давно играют в шахматы лучше людей, интерес к игре только вырос — в первую очередь, благодаря интернету. Люди играют в шахматы больше, чем когда-либо. Если сравнить шахматные партии с участием компьютера и партии между людьми, видно, что во вторых намного больше красивых комбинаций — эстетики, которая играла важную роль в шахматном образовании прошлого. Проще говоря, в человеческих партиях есть то, что принято называть «красивыми идеями», благодаря которым эта игра и получила такое распространение во всем мире.

Кляйнберг рассказал о проблеме обучения моделей, играющих как человек с рейтингом, например, 1100, 1200, 1600, 1800 или 2300, в надежде воспроизвести красивые человеческие партии. Это оказалось сложней, чем можно было ожидать. С человеческой точки зрения ходы моделей, которые пытаются имитировать игру человека, всё ещё выглядят неестественно, и лучшие попытки дают accuracy около 60%. Но результат оказался востребован — «с компьютером намного интереснее играть, когда он проигрывает» (с).

Во второй части выступления Кляйнберг упомянул старый результат: задача распознавания языка из счётно бесконечного множества неразрешима за конечное время, зато задача генерации предложений из неизвестного языка — решается. Но решить её можно тривиально: выбрать и генерировать удлиняемую простую конструкцию из языка — неинтересно. Результат группы Кляйнберга этого года — возможность делать это с константной плотностью, то есть так, чтобы выход модели покрывал ⅛ языка. С другой стороны, несложно доказать, что больше половины неизвестного произвольного языка сгенерировать теоретически невозможно.

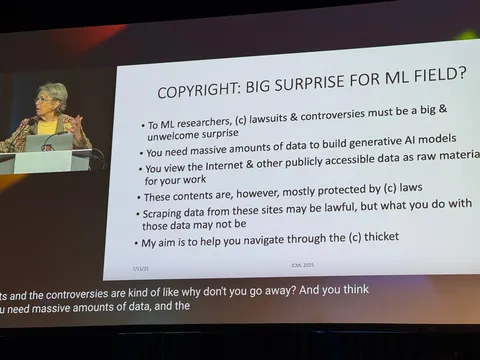

Generative AI's Collision with Copyright Law

Доклад о том, как использовать защищённые авторским правом данные для обучения моделей. Ключевой вывод — ситуация сильно зависит от страны:

— В Израиле любое использование данных для обучения признаётся fair use.

— В ЕС данные можно использовать, если к ним есть легальный доступ; при этом его нельзя ограничивать для образовательных и культурных учреждений. У авторов есть право исключать свои произведения из датасетов, используемых в обучении. В Японии и Сингапуре ситуация в целом такая же.

— В США всё сложнее из-за прецедентного права, многое решается индивидуально в суде. Авторы (в отличие от правообладателей) не могут запретить использование своих работ для обучения. А если использование данных может повлиять на рынок правообладателя, скорее всего, это считается нарушением.

Riemannian Diffusion Adaptation for Distributed Optimization on Manifolds

Отдельный лайк авторам за задачу оптимизации в римановых многообразиях. Сюда входит задача глубокого обучения с ортогональными матрицами, а это то, что помогало стабилизировать асинхронное глубокое обучение в течение продолжительного времени. На древнем рекламном фреймворке глубокого обучения такие модели — с всегда ортогональными слоями — обучались стабильнее и показывали лучшее качество (при переходе на allreduce, к сожалению, ортогональные матрицы стали вести себя так же, как обычные, но медленнее). Авторы приписывают к достоинствам метода решение задач на любых многообразиях, но при этом не сравнивают себя со специализированными методами для разных задач. Вкладка экспериментов — скромная для метода, решающего любые задачи: в abstract — четыре примера, в экспериментах — всего два, и нет сравнения со специализированными под каждую задачу методами.

Работы заметили

ML Underhood

#YaICML25