Конференция завершилась, но интересного на ней было так много, что мы продолжаем рассказывать о работах и докладах, заслуживающих внимания. CTO Яндекс Поиска Екатерина Серажим тоже побывала на площадке в Сан-Диего и поделилась своим заметками.

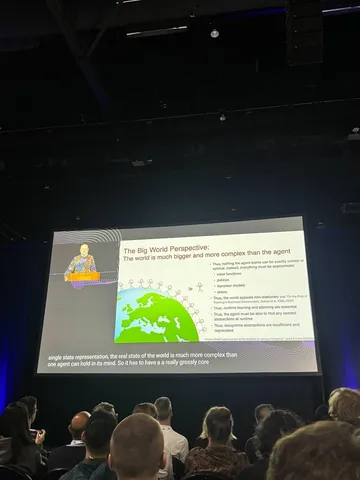

The Oak Architecture: A Vision of SuperIntelligence from Experience

На первом фото — Сан-Диего, 8 утра. Все спешат на Invited Talk Ричарда Саттона :) Доклад рекомендую: Саттон говорит, нужно не запихивать знания в агентов, а строить их такими, чтобы они масштабируемо и непрерывно изучали мир. Предлагает концепцию того, как это может быть.

WebDancer: Towards Autonomous Information Seeking Agency

У команды есть целая серия работ про deep research: на NeurIPS попала эта статья, остальные планируют представить на ICLR 2026. Авторы хитро генерируют синтетические сложные запросы, которые требуют нескольких поисков: сначала с помощью ChatGPT и других моделей составляют цепочки поисковых шагов, затем отбирают запросы, где эти цепочки не слишком длинные и не короткие, и уже на них обучаются.

Я попросила одного из авторов посоветовать другие работы на ту же тему, которые кажутся ему стоящими, и делюсь списком:

— WebSailor;

— WebSailor v2;

— Tongyi Deep Research;

— WebThinker;

— Mind2Web;

— Mind2Web v2.

А ещё пригласила ребят к нам в Москву :)

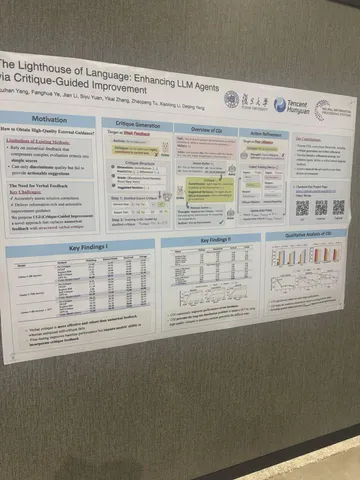

The Lighthouse of Language: Enhancing LLM Agents via Critique-Guided Improvement

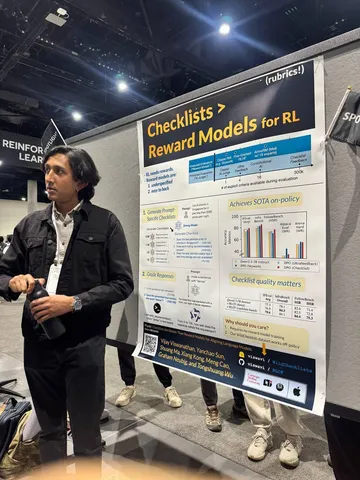

Checklists Are Better Than Reward Models For Aligning Language Models

Встретилось несколько интересных работ, где модели-генераторы улучшают с помощью моделей-критиков с текстовым фидбеком. Идея логичная: разбивать ответ на атомарные проблемы, просить модель их исправлять и учиться на этом.

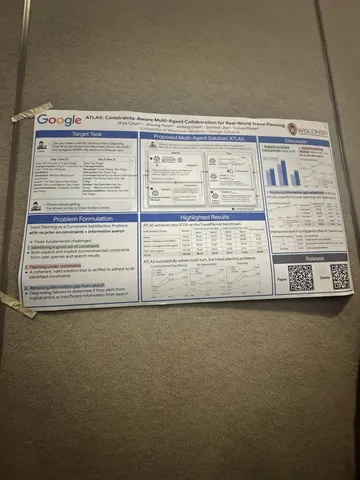

ATLAS: Constraints-Aware Multi-Agent Collaboration for Real-World Travel Planning

Ребята из Google Cloud создали агента-планировщика путешествий. Командам, которые делают нейропродукты, будет полезно посмотреть на используемые пайплайны и промпты.

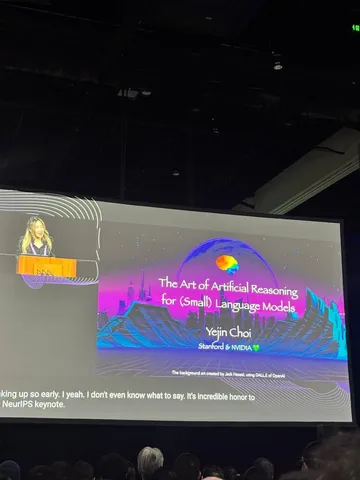

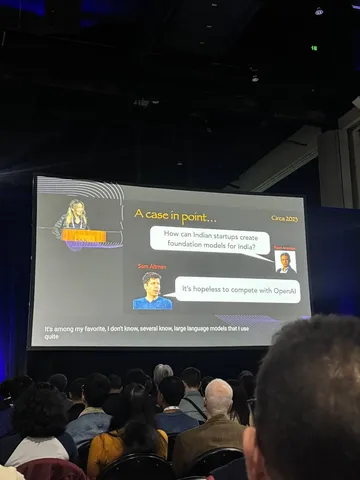

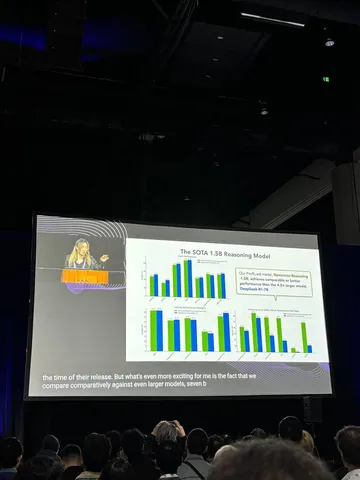

The Art of Artificial Reasoning for (Small) Language Models

Интересный кейноут Еджин Чой (Стэнфорд и NVIDIA) на тему маленьких языковых моделей. В докладе было не только визионерство, но и результаты. А ещё — мемы и трюки.

#YaNeurIPS25

ML Underhood