Хоть название и указывает на AI Safety, поначалу речь шла совсем о другом. Докладчик вспоминал, какими разнообразными и смелыми были идеи в исследованиях прошлых лет — и констатировал некоторый застой в академическом ресёрче. Подробнее об идеях из старых статей:

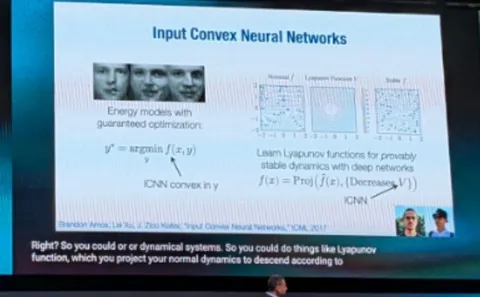

— Input Convex Neural Networks: построение выпуклой нейросети, которую можно использовать как energy-based модель.

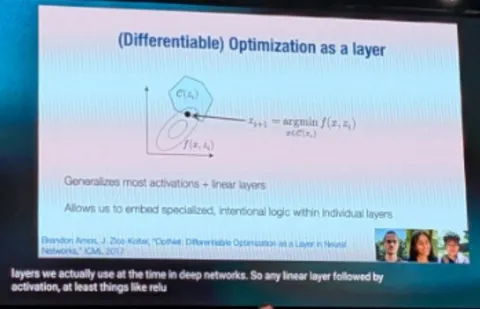

— Optimization as a Layer: слой сети внутри себя решает задачу оптимизации.

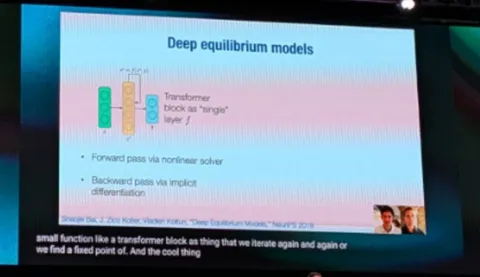

— Deep Equilibrium Models: по сути, RNN, но в итоге это направление заглохло, потому что на практике вычислительно сложные модели с малым количеством параметров уступают перепараметризованным.

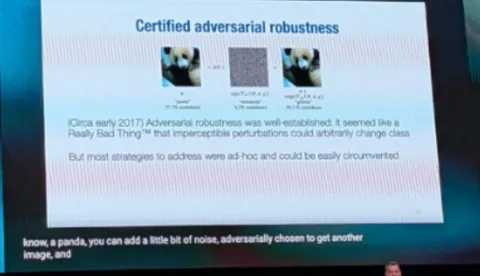

— Fighting Adversarial Samples: подходы так и не прижились, потому что все методы заметно ухудшают качество, при этом не гарантируют полное избавление от adversarial samples.

Просим прощения — фото слайдов немного не в фокусе. Но так даже вайбовее и в духе старых статей.

Послушал презентацию и записал тезисы

CV Time

#YaICLR