Визуальные токены ≠ текстовые, но в мультимодальных моделях (например, LLaVA и Chameleon) они часто используются схожим образом, без искусственного разделения.

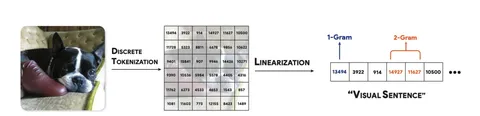

Авторы сегодняшней статьи исследуют, насколько близки естественные языки, образованные текстовыми токенами, и визуальные языки, образованные токенами визуальными. Для этого они сопоставляют визуальные языки COCO, ImageNet и других популярных датасетов, используя VQ-VAE-like токенайзеры и линеаризацию токенов изображений в 1D-последовательности (как на картинке). А потом сравнивают полученные для визуальных языков закономерности с зависимостями для естественных.

Ключевые результаты:

— В отличие от естественных языков, визуальные не подчиняются Zipf’s law: среди визуальных токенов нет превалирующих (для текстовых это, например, артикль the).

— Визуальные языки разнообразнее естественных: уникальные изображения чаще состоят из новых токенов. Авторы показывают это с помощью процесса Yule-Simon.

— Визуальные языки «естественны» — удовлетворяют Benford’s law.

— Пытаясь сжать визуальные токены кодированием Хаффмана, исследователи пришли к выводу, что визуальные языки хаотичнее, комплекснее и менее избыточны, чем естественные.

— Визуальные токены изображений чаще соотносятся с частями объектов, а не с целыми предметами.

Эмпирические исследования показали: хотя технически визуальные токены похожи на текстовые, составленные из них языки не совпадают.

По мнению авторов, это важно учитывать в обучении моделей: нейросети, которые работают с визуальными токенами, более подвержены переобучению. А комплексность и разнообразие визуальных языков требуют более долгой тренировки.

Обзор подготовил

CV Time