В Роттердаме проходит Interspeech 2025, крупнейшая мировая конференция по речевым технологиям. Тема этого года — Fair and Inclusive Speech Science and Technology. Спешим поделиться двумя интересными статьями от Alibaba Group (создателей Cosy Voice, около-SOTA TTS-модели).

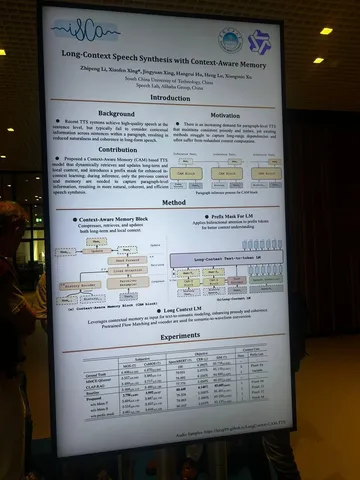

Long-Context Speech Synthesis with Context-Aware Memory

Для сохранения контекста и натуральности синтеза длинных предложений авторы предлагают механизм памяти — раздельно для текста и звука, — который авторегрессионно обновляется. При обучении история поддерживается на уровне параграфа.

Differentiable Reward Optimization for LLM based TTS system

В работе предложили метод вычисления reward-функции напрямую из токенов аудиокодека с помощью Multi-Task Reward. Модель одновременно оценивает несколько аспектов синтеза: точность произношения (через задачу ASR), эмоциональную окраску (SER), качество звучания (SQA), а также характеристики говорящего — пол и возраст. Для дифференцируемости используют Gumbel-Softmax. Главные результаты: SOTA на SEED-TTS, а также возможность контролировать в TTS-системе эмоции, пол, возраст и MOS (Mean Opinion Score).

Работы отобрал

Speech Info