Streaming Sortformer: Speaker Cache-Based Online Speaker Diarization with Arrival-Time Ordering

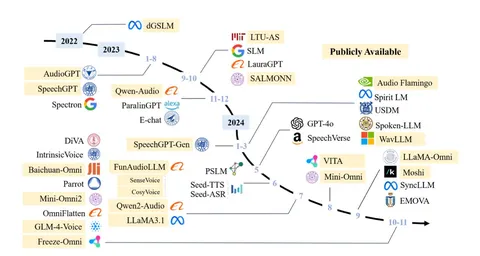

Сегодня разбираем статью с Interspeech 2025 от NVIDIA, посвящённую стриминговой end-to-end-диаризации спикеров с использованием Arrival-Time Ordering Cache. Основное применение — интеграция в multi-talker ASR. На конференции статью представлял основной автор, исследователь NVIDIA, Иван Меденников.

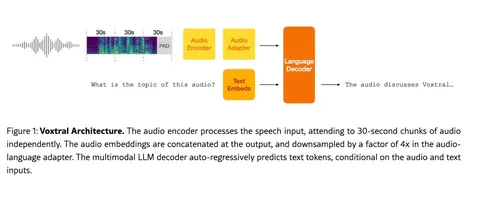

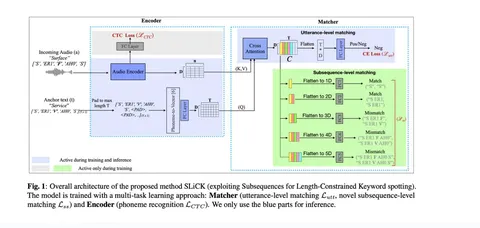

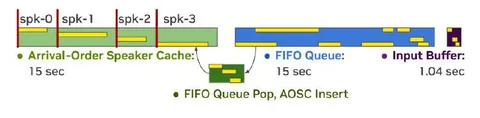

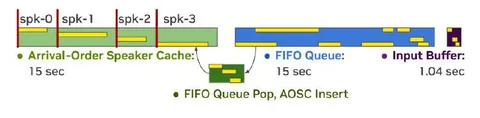

В работе представляют улучшение предыдущей модели Sortformer, в которой были предложены архитектура с Sort Loss и метод выравнивания сегментов диаризации с токенами ASR. Ключевой новинкой стал Arrival-Order Speaker Cache (AOSC) — кэш эмбеддингов спикеров, упорядоченных по времени появления. Модель работает в скользящем окне: в кэш добавляются фреймы с наивысшими оценками уверенности для каждого спикера, с динамическим распределением (минимум K фреймов на спикера и silence embeddings для переходов).

Интересные аспекты:

— Sort Loss (сортирует спикеров по времени появления, в отличие от attractor-based EEND) не заменяет полностью PIL, но их комбинация работает лучше, так как Sort Loss выполяет функцию регуляризации.

— Стриминговая версия превосходит офлайн-версию на длинных записях, устраняя train-inference mismatch (обучение на 90-секундных сегментах vs произвольная длина теста).

— Инициализация от предобученного офлайн Sortformer полезна, но fine-tuning с AOSC обязателен, так как фреймы в кэше могут быть непоследовательными.

— Обучение проводилось на 5150 часах симулированных смесей и 2030 часах реальных данных. С синтетикой нужно быть осторожными: модель склонна к оверфиту на background noise.

Эксперименты показывают SOTA для E2E-онлайн-диаризации с достаточно низкой latency.

Ограничения модели следующие: фиксированное максимальное число спикеров (4 в работе), масштабирование требует данных с большим числом дикторов и растёт вычислительная сложность PIL (O(N!) для перестановок).

Дмитрий Попов❣ Специально для Speech Info

Сегодня разбираем статью с Interspeech 2025 от NVIDIA, посвящённую стриминговой end-to-end-диаризации спикеров с использованием Arrival-Time Ordering Cache. Основное применение — интеграция в multi-talker ASR. На конференции статью представлял основной автор, исследователь NVIDIA, Иван Меденников.

В работе представляют улучшение предыдущей модели Sortformer, в которой были предложены архитектура с Sort Loss и метод выравнивания сегментов диаризации с токенами ASR. Ключевой новинкой стал Arrival-Order Speaker Cache (AOSC) — кэш эмбеддингов спикеров, упорядоченных по времени появления. Модель работает в скользящем окне: в кэш добавляются фреймы с наивысшими оценками уверенности для каждого спикера, с динамическим распределением (минимум K фреймов на спикера и silence embeddings для переходов).

Интересные аспекты:

— Sort Loss (сортирует спикеров по времени появления, в отличие от attractor-based EEND) не заменяет полностью PIL, но их комбинация работает лучше, так как Sort Loss выполяет функцию регуляризации.

— Стриминговая версия превосходит офлайн-версию на длинных записях, устраняя train-inference mismatch (обучение на 90-секундных сегментах vs произвольная длина теста).

— Инициализация от предобученного офлайн Sortformer полезна, но fine-tuning с AOSC обязателен, так как фреймы в кэше могут быть непоследовательными.

— Обучение проводилось на 5150 часах симулированных смесей и 2030 часах реальных данных. С синтетикой нужно быть осторожными: модель склонна к оверфиту на background noise.

Эксперименты показывают SOTA для E2E-онлайн-диаризации с достаточно низкой latency.

Ограничения модели следующие: фиксированное максимальное число спикеров (4 в работе), масштабирование требует данных с большим числом дикторов и растёт вычислительная сложность PIL (O(N!) для перестановок).

Дмитрий Попов

1 008 просмотров · 23 реакций

Открыть в Telegram · Открыть пост на сайте