Beyond Transcripts: A Renewed Perspective on Audio Chaptering [2/2]

Продолжаем разбирать статью на тему аудиочаптеринга. В первой части рассказали о специфике задачи, метриках и подходах, которые сравнивают авторы. Переходим к самому интересному — результатам.

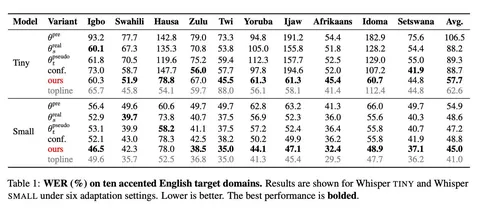

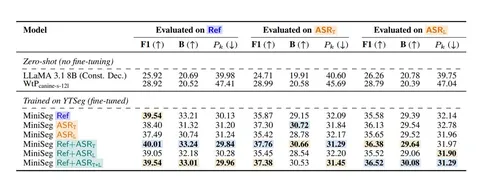

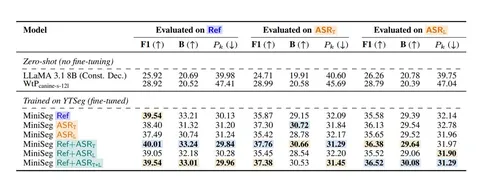

Первый аблейшн — качество транскрипта. Сравнивают сегментацию на референсном тексте, Whisper Tiny и Whisper Large. Разница неожиданно небольшая: более качественный ASR не всегда даёт лучшую сегментацию. Модели в основном лучше работают на том типе транскрипта, на котором их обучали. Zero-shot LLM-ки почти не чувствительны к качеству транскрипта, но сильно уступают специализированным моделям, обученным на сегментацию.

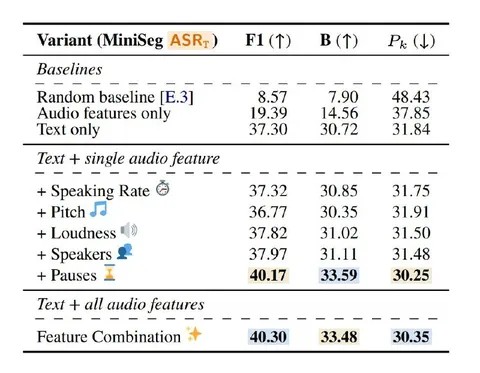

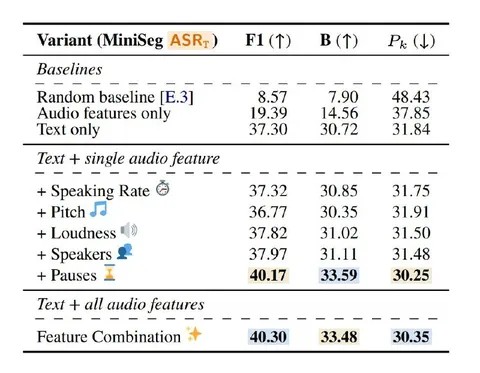

Второй аблейшн — аудиофичи для текстовой модели. Добавляют паузы, скорость речи, pitch, громкость, смену спикера. Все фичи вместе дают примерно +19 F1, то есть аудио действительно добавляет сигнал. Но главный вклад даёт длина паузы: добавление остальных фичей почти не меняет результат.

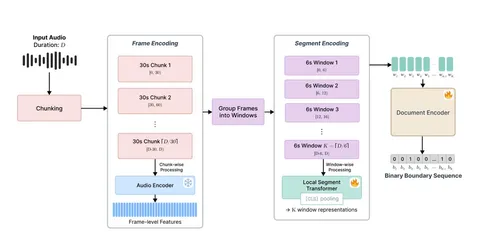

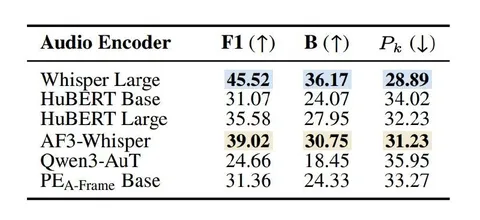

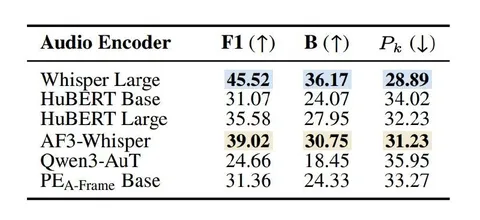

Третий аблейшн — audio-only-модели. Тестируют разные аудиоэнкодеры внутри AudioSeg. Лучше всего работает Whisper, что логично: его эмбеддинги содержат текстовую семантику. Модели для чисто акустических задач (например sound event detection) тоже работают, но хуже.

Отдельно смотрят, на каких сэмплах аудио даёт профит. Модель часто ловит границы по неспичевым сигналам: интро- и аутро-звукам, музыкальным переходам, эффектам. Когда такие сигналы чистят с помощью noise filtering, качество сегментации падает — значит, модель действительно на них опирается.

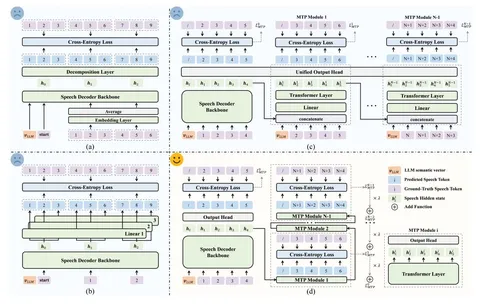

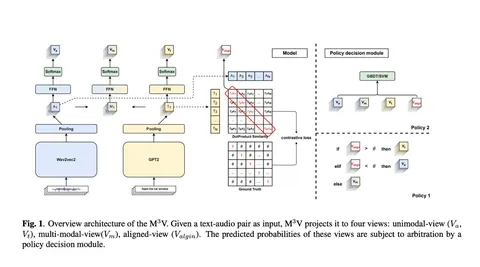

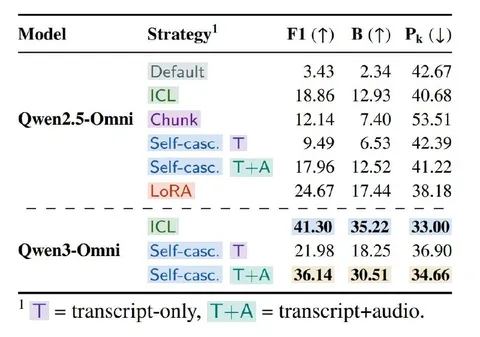

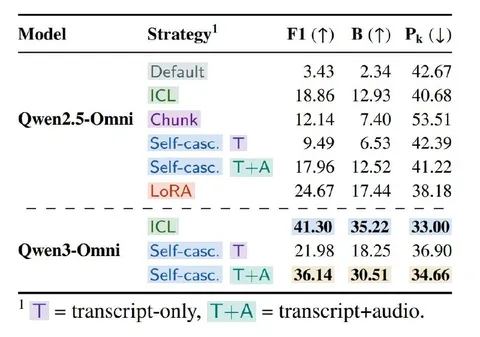

Про MLLM-ки. Проверяют zero-shot, chunking, in-context learning, self-cascade и LoRA. Базовый zero-shot неожиданно плохой, иногда даже хуже рандома. In-context learning и LoRA помогают, а лучший результат даёт self-cascade: сначала генерируется транскрипт, потом делается сегментация, и лучше всего работает вариант, когда модели дают и транскрипт, и аудио. Но даже так мультимодалки уступают AudioSeg.

Дальше смотрят срезы по длительности аудио. На коротких записях AudioSeg работает лучше остальных, но на длинных (около часа и больше) преимущество постепенно исчезает, и модели показывают похожие результаты.

Похожая история со спикерами. Чем больше говорящих, тем сложнее задача и тем ниже качество. Добавление простых спикерных фичей, например смены спикера, немного помогает текстовой модели.

Последний момент — ограничение постановки. Использующийся протокол T1 расставляет границы с шагом шесть секунд (и такой же шаг используется моделью). Поэтому даже идеальная модель не может быть точнее. Если притянуть реальные границы к этим окнам (oracle-сегментация), получается потолок F1 около 81.

Даниил Волгин❣ Специально для Speech Info

Продолжаем разбирать статью на тему аудиочаптеринга. В первой части рассказали о специфике задачи, метриках и подходах, которые сравнивают авторы. Переходим к самому интересному — результатам.

Первый аблейшн — качество транскрипта. Сравнивают сегментацию на референсном тексте, Whisper Tiny и Whisper Large. Разница неожиданно небольшая: более качественный ASR не всегда даёт лучшую сегментацию. Модели в основном лучше работают на том типе транскрипта, на котором их обучали. Zero-shot LLM-ки почти не чувствительны к качеству транскрипта, но сильно уступают специализированным моделям, обученным на сегментацию.

Второй аблейшн — аудиофичи для текстовой модели. Добавляют паузы, скорость речи, pitch, громкость, смену спикера. Все фичи вместе дают примерно +19 F1, то есть аудио действительно добавляет сигнал. Но главный вклад даёт длина паузы: добавление остальных фичей почти не меняет результат.

Третий аблейшн — audio-only-модели. Тестируют разные аудиоэнкодеры внутри AudioSeg. Лучше всего работает Whisper, что логично: его эмбеддинги содержат текстовую семантику. Модели для чисто акустических задач (например sound event detection) тоже работают, но хуже.

Отдельно смотрят, на каких сэмплах аудио даёт профит. Модель часто ловит границы по неспичевым сигналам: интро- и аутро-звукам, музыкальным переходам, эффектам. Когда такие сигналы чистят с помощью noise filtering, качество сегментации падает — значит, модель действительно на них опирается.

Про MLLM-ки. Проверяют zero-shot, chunking, in-context learning, self-cascade и LoRA. Базовый zero-shot неожиданно плохой, иногда даже хуже рандома. In-context learning и LoRA помогают, а лучший результат даёт self-cascade: сначала генерируется транскрипт, потом делается сегментация, и лучше всего работает вариант, когда модели дают и транскрипт, и аудио. Но даже так мультимодалки уступают AudioSeg.

Дальше смотрят срезы по длительности аудио. На коротких записях AudioSeg работает лучше остальных, но на длинных (около часа и больше) преимущество постепенно исчезает, и модели показывают похожие результаты.

Похожая история со спикерами. Чем больше говорящих, тем сложнее задача и тем ниже качество. Добавление простых спикерных фичей, например смены спикера, немного помогает текстовой модели.

Последний момент — ограничение постановки. Использующийся протокол T1 расставляет границы с шагом шесть секунд (и такой же шаг используется моделью). Поэтому даже идеальная модель не может быть точнее. Если притянуть реальные границы к этим окнам (oracle-сегментация), получается потолок F1 около 81.

Даниил Волгин

277 просмотров · 19 реакций

Открыть в Telegram · Открыть пост на сайте