В первой части разбора мы рассказали об особенностях архитектуры DeepSeek-OCR и ключевых задачах, которые решали авторы. А теперь посмотрим на нюансы обучения и на озвученные результаты.

Обучение модели

Процесс упрощён и включает только две стадии: тренировку энкодера и обучение модели целиком.

Важный момент: во время тренировки энкодера DeepEncoder учится работать и в режиме native-resolution, и в режиме tile-based-resolution. То есть модель видит как большие картинки, так и маленькие в разных представлениях.

Энкодер тренируется на парах картинок и текстовых описаний по схеме, описанной в статье Vary: к нему приделывается маленький текстовый декодер, и они вместе обучаются авторегрессионно.

Второй этап с обучением всей VLM повторяет обычный претрейн/SFT во множестве других VLM.

Результаты

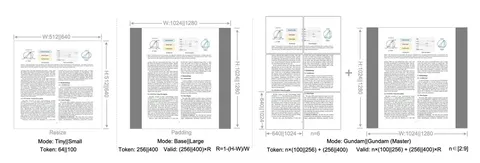

Авторы представляют небольшую мультиязычную модель, которая может обрабатывать изображения в разном размере и даже в разных режимах динамического разрешения (tile-based, native-resolution).

Замеры точности распознавания в зависимости от размера изображения (и числа токенов) на OCR-бенчмарке Fox показывают, что для надёжного чтения текста можно использовать примерно в 10 раз меньше картиночных токенов, чем необходимо текстовых токенов для представления текста на изображении. При уменьшении этого соотношения качество чтения быстро падает.

DeepSeek-OCR показывает отличное качество на OmniDocBench, опережая в зависимости от разрешения не только сильные опенсорсные бэйзлайны, вроде Qwen-2.5VL, но и Gemini2.5-Pro. При этом скорость обработки на GPU сопоставима с пайплайновыми OCR-пакетами, такими как Miner, обрабатывая около двух изображений в секунду на А100.

В заключение можно заметить, что хотя результаты вышли довольно впечатляющими, в работе использованы только бенчмарки с фокусом на PDF-подобных картинках, а другие, более разнообразные OCR-бенчи для VLM (OCRBench_v2, CC-OCR), не замеряны. Также в статье нет аблейтов влияния на результаты ни выбранной архитектуры, ни этапов обучения, поэтому авторы сами называют свои результаты proof-of-concept.

Разбор подготовил

CV Time